【本文作者Matt Welsh (mdw@mdw.la)是一家最近成立的初創公司Fixie.ai(緻力于開發人工智能功能來支持軟件開發團隊)的首席執行官和聯合創始人。他曾是哈佛大學計算機科學教授、谷歌的工程總監、蘋果的工程主管,以及OctoML的工程高級副總裁。他在加州大學伯克利分校獲得博士學位的時候,人工智能還不太會下國際象棋。】

本文The End of Programming 發表于 JANUARY 2023 | VOL. 66 | NO. 1 | COMMUNICATIONS OF THE ACM(《美國計算機協會通訊》),本文隻代表着其中一種觀點,但由權威刊出,說明這種觀點值得關注。

上世紀80年代,我長大了,開始在家中為Commodore VIC-20和Apple等個人電腦編程。我在大學裡繼續學習計算機科學(CS),并最終在伯克利獲得博士學位,我的大部分專業培訓都植根于我稱之為“經典”的CS:編程、算法、數據結構、系統、編程語言。在經典計算機科學中,最終目标是将一個想法簡化為由Java、C++或Python等語言編寫的程序。經典計算機科學中的每一個思想——無論多麼複雜,從數據庫連接算法到令人難以置信而滑稽的Paxos共識協議——都可以表達為人類可讀、可理解的程序。

上世紀90年代初,當我還在上大學的時候,我們還處于AI寒冬的深處,AI作為一個領域同樣被經典算法所主導。我在康奈爾大學的第一份研究工作是和Dan Huttenlocher一起工作,他是計算機視覺領域的領軍人物

(現在是麻省理工學院施瓦茨曼計算學院的院長)

。1995年前後,在Huttenlocher 的計算機視覺的博士生課程中,我們從未讨論過任何類似于深度學習或神經網絡的東西,而是經典算法,如Canny邊緣檢測、光流和Hausdorff距離。深度學習還處于起步階段,還沒有被認為是主流人工智能,更不用說主流計算機科學了。

當然,這是30年前的事情了,從那時起發生了很多變化,但有一件事沒有真正改變——計算機科學是一門 “數據結構、算法和編程”作為其核心的學科來教授的

。如果再過30年,甚至10年,我們還在用這種方式研究計算機科學,我會感到驚訝的。事實上,我認為計算機科學作為一個領域正在經曆一個巨大的變遷——我們中很少有人真正做好了準備。

編程将被淘汰,

我相信“寫程序” 的傳統觀念正在走向消亡。事實上,除了非常專業的應用,我們所知道的大多數軟件将被經過訓練而不是編程的人工智能系統所取代。在需要一個“簡單”程序的情況下

(畢竟,并不是所有的程序都需要一個運行在GPU集群上、有數千億個參數的大模型)

,這些程序本身将由人工智能生成,而不是手工編碼。

我不認為這個想法很瘋狂。毫無疑問,從(相對)原始的電氣工程洞穴中走出的最早的計算機科學先驅們堅信,所有未來的計算機科學家都需要對半導體、二進制算術和微進程設計有深刻的理解才能理解軟件。快進到今天,我敢打賭99%的編寫軟件的人幾乎不知道CPU是如何工作的,更不用說晶體管設計的物理基礎了。通過擴展,我相信未來的計算機科學家将遠離“軟件”的經典定義,他們将很難逆轉鍊表或實現快速排序。

(見鬼,我不确定我是否還記得如何實現快速排序。)

像CoPilot這樣的AI編碼助手隻是觸及了我所描述的内容的表面。在我看來,很明顯,未來所有的程序最終都将由AI來編寫,而人類充其量隻能扮演監督的角色。任何懷疑這一預測的人隻需看看AI内容生成的其他方面(如圖像生成)正在取得的驚人進展。DALL-E v1和僅在15個月後宣布的DALL-E v2在質量和複雜性上的差異是驚人的。如果說我在過去幾年的人工智能工作中學到了什麼,那就是,人們很容易低估日益龐大的人工智能模型的力量。幾個月前還像是科幻小說的事情正在迅速成為現實。

(創造出令人驚豔的圖像, https://openai.com/dall-e-2/)

所以,我不隻是在談論像Github的CoPilot

[1]

取代程序員,而要說的是,用訓練模型取代編寫程序的整個概念。在未來,計算機科學的學生将不需要學習諸如如何向二叉樹添加節點或C++代碼這樣的平凡技能。這種教育将會過時,就像教工程專業的學生如何使用計算尺一樣。

未來的工程師隻需敲擊幾下鍵盤,就能啟動一個包含400億億個參數(four-quintillion-parameter)的模型實例,這個模型已經對人類知識的全部範圍(包括子集)進行了編碼,并随時準備執行機器要求的任何任務。讓機器做我們想做的事情的大部分腦力工作将是提出正确的示例、正确的訓練數據和正确的方法來評估訓練過程。像基于小樣本學習(few-shot learning)且能泛化的、這樣強大的模型隻需要執行任務的幾個好的示例。在大多數情況下,大規模的、人工管理的數據集将不再是必要的,大多數人“訓練”一個AI模型将不會在PyTorch中運行梯度下降循環( gradient descent loops )或類似的東西。他們隻是教模型幾個示例,機器将完成其餘的工作。

在這門新的計算機科學中——如果我們還稱之為計算機科學的話——機器将如此強大,并且已經知道如何做很多事情,這一領域将看起來不像一個工程領域,而更像一個教育領域。也就是說,如何最好地教育機器,就像如何最好地教育學校裡的孩子一樣。不過,與(人類)孩子不同的是,這些人工智能系統将駕駛我們的飛機、運行我們的電網,甚至可能統治整個國家。我認為,當我們的注意力轉向教授智能機器而不是直接編程時,絕大多數經典CS就變得無關緊要了。傳統意義上的編程實際上将會消亡。

我認為CS作為一個領域正在經曆一場相當大的劇變,我們中很少有人真正做好了準備。

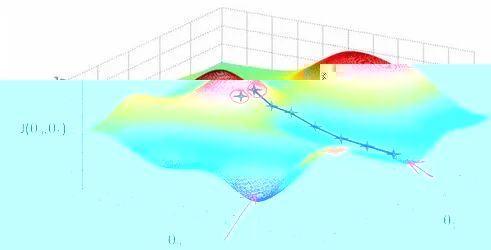

這一切将如何改變我們對計算機科學領域的看法?新的原子計算單元不再是處理器、内存和I/O系統,而是一個大規模的、預先訓練過的、高度自适應的AI模型。這對我們思考計算的方式來說是一個巨大的轉變——不再是一個可預測的、靜态的、受指令集、類型系統和可判定性概念支配的過程。基于人工智能的計算早已跨越了靜态分析和形式證明的界限。我們正在迅速走向這樣一個世界,在這個世界裡,計算的基本構件是有氣質的、神秘的、自适應的代理。

沒有人真正了解大型人工智能模型是如何工作的,這一事實突顯了這種轉變。人們發表的研究論文實際上發現了現有大型模型的新行為,即使這些系統是由人類“設計”出來的。大型人工智能模型能夠做一些它們沒有受過明确訓練的事情,這應該會把Nick Bostrom[2]和其他擔心超級智能人工智能橫行的人吓得魂飛魄滅(這是正确的)。除了實證研究,我們目前沒有辦法确定當前人工智能系統的局限性。至于未來更大更複雜的人工智能模型——祝我們好運!

對于任何讀過現代機器學習論文的人來說,焦點從程序到模型的轉變應該是顯而易見的。這些論文幾乎沒有提到創新背後的代碼或系統:人工智能系統的構建模塊是更高層次的抽象,如注意力層(attention layers)、标記器(tokenizers)和數據集。即使是20年前的時間旅行者,也很難理解GPT-3論文[3](描述為該模型構建的實際軟件)的三句話(three sentences):

“我們使用與GPT-2相同的模型和架構,包括其中描述的修改後的初始化、預歸一化和可逆标記化,除了我們在Transformer Layer中使用交替的密集和局部稀疏注意力模式,類似于 稀疏矩陣(Sparse Transformer)。為了研究ML性能對模型大小的依賴關系,我們訓練了8種不同大小的模型,從1.25億個參數到1750億個參數,範圍超過三個數量級,最後一個是我們稱之為GPT-3的模型。先前的工作表明,在足夠的訓練數據下,驗證損失的縮放應該近似于一個平滑幂律(power law)作為規模的函數。許多不同規模的訓練模型允許我們測試這個假設的驗證損失(validation loss )和下遊語言任務。”

計算基礎定義的這種轉變帶來了巨大的機遇,也帶來了巨大的風險。然而,我認為現在是時候接受這是一個很有可能的未來,并相應地發展我們的思想,而不是隻是坐在這裡等待流星撞擊。

參考文獻:

Berger, E. Coping with copilot. SIGPLAN PL Perspectives Blog, 2022; https://bit.ly/3XbJv5J

Bostrom, N. Superintelligence: Paths, Dangers, Strategies. Oxford University Press, 2014.

Brown, T. et al. Language models are few-shot learners. 2020; https://bit.ly/3Eh1DT5

Kojima, T. et al. Large language models are zero-shot reasoners. 2022; https://bit.ly/3Ohmlqo

Nye, M. et al. Show your work: Scratchpads for intermediate computation with language models. 2021; https://bit.ly/3TLnfMY

版權歸原作者所有,如有侵權,請聯系删除